Por qué la DRAM sola ya no puede seguirle el ritmo a la IA

En cuanto empiezas a fijarte en cómo están construidos realmente los sistemas de IA, hay una conclusión muy natural a la que la gente suele llegar y, para ser justos, al principio suena perfectamente razonable.

Si NAND es demasiado lento para ciertas partes de la carga de trabajo, e incluso las arquitecturas flash avanzadas siguen introduciendo suficiente retraso como para importar, entonces la respuesta obvia parecería ser agregar más DRAM. Después de todo, la DRAM siempre ha sido la capa rápida. Es donde viven los datos activos, responde con rapidez y, durante décadas, ha sido la parte del sistema en la que te apoyas cuando no quieres que el procesador se quede inactivo esperando a que algo llegue.

Así que la suposición es fácil de hacer: si el problema es la velocidad, entonces amplía lo más rápido que ya tienes.

Esa lógica se sostiene bastante bien hasta que entra la IA en escena y empieza a empujar a la DRAM hacia un papel para el que nunca fue realmente diseñada. El problema no es que la DRAM se haya vuelto de repente lenta, obsoleta o de algún modo menos útil que antes. El problema es que las cargas de trabajo de IA le están pidiendo mucho más que simplemente actuar como una capa rápida de trabajo entre compute y almacenamiento.

Para entender mejor el marco general detrás de este cambio, este artículo se conecta directamente con la pieza principal de esta serie: NAND no va a desaparecer, pero los servidores de IA ahora dependen de algo más que solo flash.

La DRAM fue construida para la velocidad, no para cargar con todo el sistema

Lo primero que hay que entender es que la DRAM siempre ha estado optimizada para la velocidad y la capacidad de respuesta, no para almacenar cantidades enormes de datos a gran escala. En la computación tradicional, esa diferencia rara vez era un problema porque la mayoría de las cargas de trabajo tenían una separación bastante clara entre los datos activos y los datos almacenados. El sistema mantenía en memoria lo que necesitaba de inmediato, traía el resto desde el almacenamiento cuando hacía falta y esa transferencia normalmente era lo bastante buena como para que nadie pensara demasiado en ello.

La IA cambia ese equilibrio de forma bastante drástica. En lugar de trabajar con pequeños bloques de datos activos y seguir adelante, los modelos de IA tienden a volver una y otra vez sobre grandes conjuntos de datos, mover información en paralelo y mantener una parte mucho más grande del working set al alcance de la capa de compute durante períodos mucho más largos. Eso significa que ya no se le pide a la DRAM simplemente que conserve la tarea actual. Ahora se le pide ayudar a sostener una enorme masa de datos, en constante cambio, que el sistema quiere tener cerca prácticamente todo el tiempo.

Ese es un trabajo muy distinto.

Y esa es también la razón por la que las tecnologías por encima y alrededor de la DRAM se han vuelto más importantes. En el artículo anterior sobre qué es la High Bandwidth Memory y por qué la IA depende de ella, el enfoque estaba en mover una cantidad más pequeña de datos críticos extremadamente cerca del procesador para que la GPU siga alimentada. Ese artículo deja claro que la proximidad importa, pero también revela silenciosamente el siguiente problema, porque una vez que el working set crece más allá de esa capa inmediata, el sistema todavía tiene que decidir dónde va a vivir todo lo demás.

La primera pared es el costo, y aparece muy rápido

Una de las razones por las que a la gente le gusta la idea de “simplemente agregar más DRAM” es que suena limpia y directa. En la práctica, se vuelve costosa muy rápido. La DRAM simplemente no tiene el mismo precio que NAND y, en cuanto empiezas a escalar sistemas al terreno de la IA, ya no estás hablando de agregar un poco más de memoria a un servidor. Estás hablando de cientos de gigabytes, a veces mucho más, repartidos entre muchos nodos, racks y clústeres.

En ese punto, la DRAM deja de sentirse como una mejora de rendimiento y empieza a parecer una carga de infraestructura. La curva de costos no sube suavemente. Sube con suficiente rapidez como para que la idea de usar DRAM para resolver todos los problemas de localidad de datos empiece a desmoronarse bajo su propia economía.

Esa es una de las razones por las que la pila de memoria se está volviendo más profunda en lugar de más simple. La industria no se está alejando de la DRAM porque haya dejado de ser valiosa. Se está alejando de la suposición de que la DRAM sola puede ser la respuesta a todos los problemas sensibles a la latencia a escala de IA.

La segunda pared es la energía, y ese problema nunca duerme

Incluso si el costo fuera más fácil de justificar, la DRAM todavía tropieza con otro problema que se vuelve imposible de ignorar una vez que los sistemas alcanzan cierto tamaño, y ese problema es la energía. La DRAM debe mantenerse constantemente alimentada para conservar su estado. Eso es simplemente parte de la tecnología. Así que, cuanto más agregas, más energía consume el sistema solo para mantener esos datos ahí, listos para usarse.

En entornos pequeños, esa sobrecarga puede parecer aceptable. En sistemas de IA densos que funcionan de manera continua, empieza a convertirse en un problema operativo importante. Más DRAM significa más consumo eléctrico, más calor, más refrigeración y más presión de diseño sobre toda la plataforma. De pronto, la decisión ya no trata solo de capacidad de memoria. Trata de límites térmicos, eficiencia del centro de datos y de si la infraestructura de soporte puede absorber el costo de mantener viva tanta memoria activa las veinticuatro horas del día.

Aquí es también donde el papel de las capas intermedias empieza a tener más sentido. En la entrega anterior sobre Storage Class Memory, la capa que falta entre DRAM y NAND, la idea no era reemplazar la DRAM, sino aliviar parte de la presión sobre ella introduciendo una capa que mantenga más datos cerca del compute sin obligar a que todo termine en el nivel más costoso y más hambriento de energía.

Luego está la realidad física de la proximidad

Hay otra razón por la que la DRAM no escala infinitamente bien en los sistemas de IA, y tiene menos que ver con el presupuesto y más con la física. La DRAM aporta valor en parte porque se encuentra relativamente cerca del procesador. Cuanto más cerca está la memoria del compute, menor suele ser la latencia y más ágil se siente el sistema en general. Pero la proximidad no es algo que puedas expandir para siempre sin consecuencias.

Existen límites físicos a la cantidad de memoria que puede colocarse cerca de una CPU o GPU antes de que la complejidad del diseño, la longitud de las trazas, la integridad de la señal y las restricciones de encapsulado empiecen a jugar en tu contra. Esa es exactamente la razón por la que apareció el empaquetado avanzado de memoria en primer lugar. La HBM existe porque la colocación tradicional de la DRAM solo puede llegar hasta cierto punto, y una vez que el lado de compute se vuelve lo bastante rápido, esas distancias y esos recorridos empiezan a importar más de lo que importaban antes.

Pero la HBM tampoco es una respuesta completa en términos de capacidad. Ofrece un ancho de banda increíble, pero no un volumen ilimitado. Así que el sistema termina viviendo en un equilibrio constante entre lo que puede colocarse muy cerca y lo que tiene que permanecer más lejos. Las cargas de trabajo de IA tensan ese equilibrio mucho más de lo que jamás lo hicieron los sistemas convencionales.

La IA hace que los pequeños retrasos salgan caros

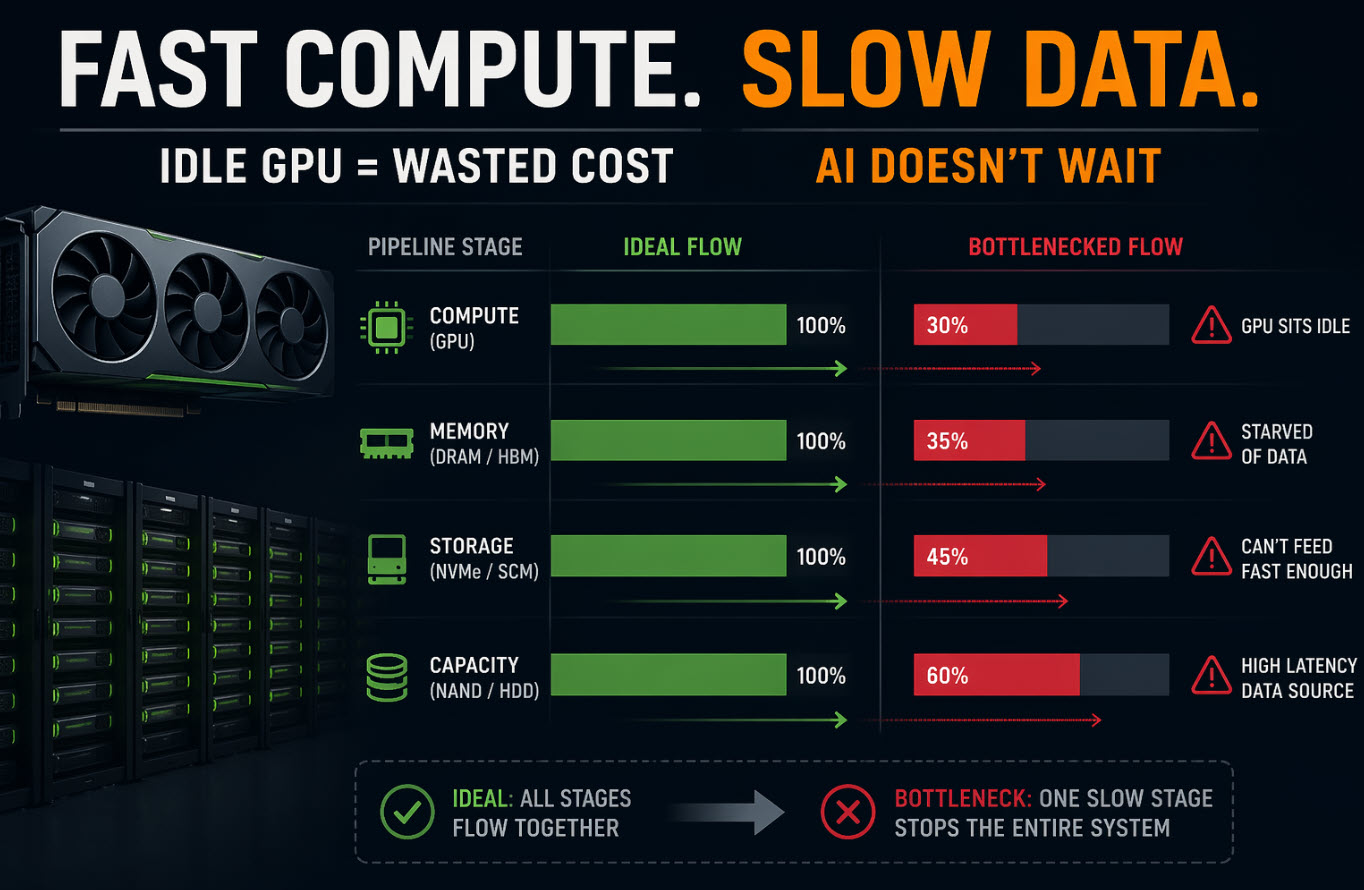

Una de las cosas más interesantes de la infraestructura de IA es que expone ineficiencias que las cargas de trabajo más antiguas podían ocultar casi por completo. En un sistema más tradicional, un pequeño retraso en el acceso a los datos quizá no signifique gran cosa. El procesador espera un poco, la tarea termina un poco más tarde y el usuario ni se entera. Los sistemas de IA son mucho menos tolerantes porque operan con muchísimo paralelismo y con una enorme cantidad de dinero atada a la capa de compute.

Si una GPU no recibe los datos cuando los necesita, eso no es solo una molestia técnica. Es tiempo muerto costoso. Multiplica eso por muchos aceleradores funcionando en paralelo y hasta retrasos muy pequeños empiezan a aparecer como pérdidas reales de utilización.

Eso cambia el objetivo. El objetivo no es simplemente tener memoria rápida. El objetivo es mantener una entrega de datos lo bastante consistente, a una escala lo bastante grande, como para mantener ocupadas todo el tiempo las partes más caras del sistema. Ese es un requisito mucho más duro, y es exactamente por eso que la DRAM sola empieza a parecer insuficiente una vez que la infraestructura de IA crece más allá de cierto punto.

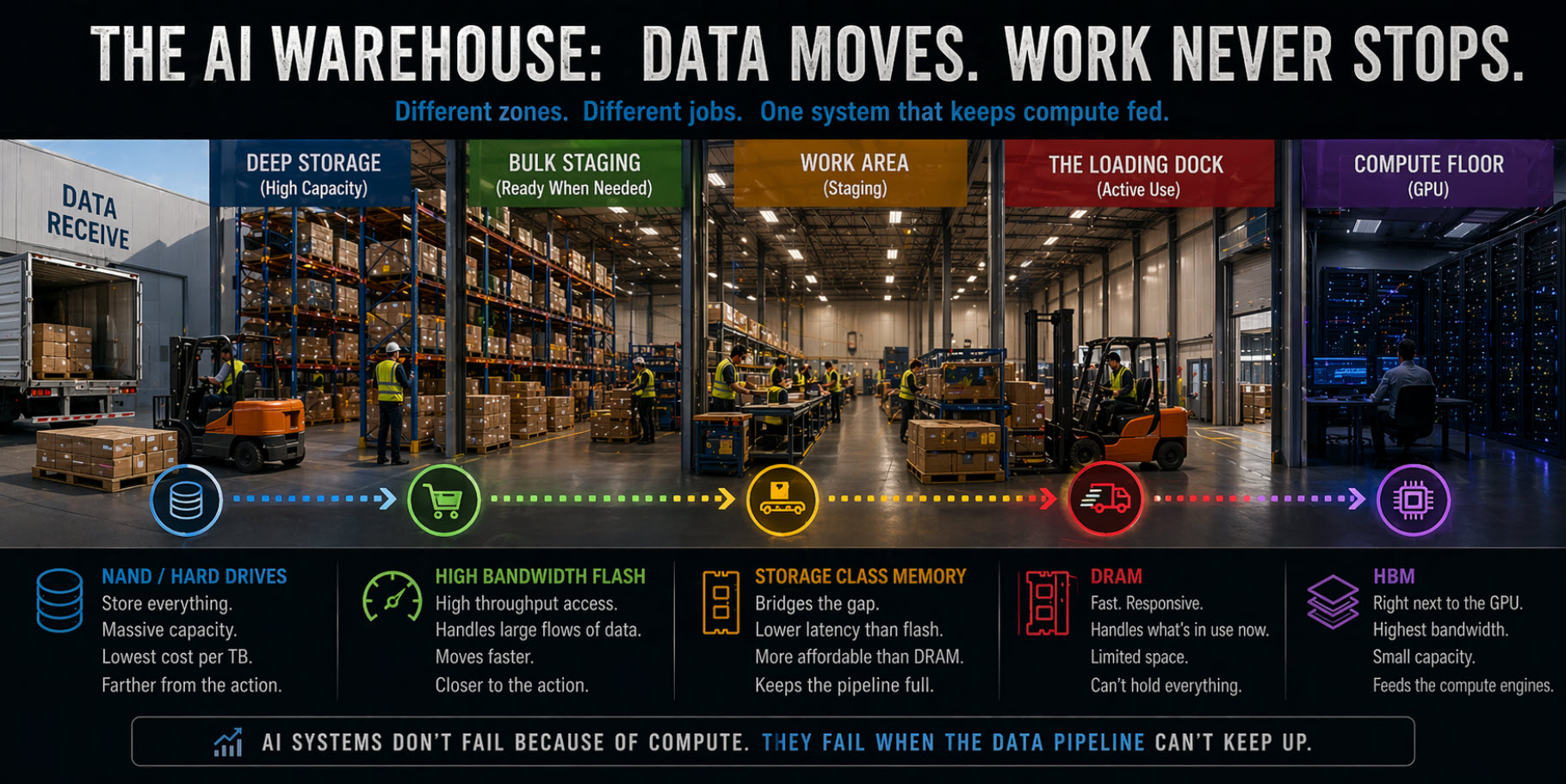

La analogía del almacén sigue funcionando, solo que ahora es más grande

Si seguimos usando la misma analogía del almacén de los artículos anteriores, la DRAM sigue siendo el muelle de carga. Es donde ocurre el trabajo activo, donde los elementos se abren, se clasifican y se mueven hacia el uso inmediato. Durante años, ese modelo funcionó bien porque la cantidad de actividad en el muelle era manejable y el sistema no exigía que todo estuviera preparado ahí al mismo tiempo.

La IA cambia la escala de toda la operación. Ahora se espera que el muelle soporte un flujo casi constante de material, con mucha más actividad ocurriendo en paralelo y con mucha menos tolerancia al retraso. En algún punto, incluso el mejor muelle de carga no puede seguir creciendo sin más. Solo hay cierto espacio, solo cierto número de movimientos paralelos que pueden ocurrir con eficiencia y solo cierta cantidad de inventario que puedes mantener directamente en el punto de uso antes de que el propio diseño se convierta en parte del problema.

Así que la respuesta no es hacer el muelle infinitamente más grande. La respuesta es rediseñar el flujo de trabajo alrededor de él.

Ahí es donde el resto de la jerarquía de memoria empieza a ganarse su lugar. La HBM mantiene los datos más sensibles al tiempo justo al lado del procesador. La Storage Class Memory ayuda a suavizar la transición entre la memoria activa y el almacenamiento más lento. Y en el artículo más reciente sobre por qué los sistemas modernos de inteligencia artificial consumen tanta memoria, el enfoque se desplazó hacia cómo también se está rediseñando el lado del almacenamiento para que pueda participar de forma más inteligente en alimentar al sistema.

Ninguna de esas capas existe porque la DRAM haya fallado. Existen porque la IA ya superó la idea de que una sola capa rápida pudiera cargar por sí sola con toda la carga de trabajo.

Lo que esto realmente significa para la pila de memoria de la IA

La verdadera conclusión aquí no es que la DRAM vaya a desaparecer, porque claramente no es así. La DRAM sigue siendo una de las partes más importantes de toda la pila. Lo que está cambiando es su papel. En vez de ser el lugar donde se supone que vive todo lo activo, la DRAM se está convirtiendo en el lugar donde viven los datos más urgentes y más sensibles al tiempo, mientras otras capas se encargan de la creciente carga de escala, costo y capacidad.

Ese es un cambio sutil, pero importante. Significa que la infraestructura de IA se está alejando de la vieja idea de un modelo simple de dos capas – memoria aquí, almacenamiento allá – y se está moviendo hacia algo mucho más matizado, donde a cada tecnología se le pide manejar la parte de la carga de trabajo para la que está mejor adaptada.

Dicho de forma simple, la DRAM sigue siendo esencial, pero por sí sola ya no basta. La IA ha cambiado el tamaño del working set, la velocidad del compute, el costo del retraso y la economía de mantenerlo todo cerca. Cuando todo eso cambia al mismo tiempo, la jerarquía de memoria también tiene que cambiar con ello.

Hacia dónde lleva esto después

Una vez que aceptas que la DRAM no puede estirarse lo suficiente como para contener todo lo que la IA quiere cerca del compute, la siguiente pregunta se vuelve bastante obvia. ¿Dónde vive realmente el resto de esos datos, especialmente cuando la cantidad de información involucrada es demasiado grande como para justificar mantenerla en memoria?

Ahí es donde la conversación vuelve a girar, y una tecnología que mucha gente supone que ya quedó relegada empieza a importar de una manera sorprendentemente importante. Porque, mientras la DRAM lucha con la escala y el flash sigue arrastrando sus propias compensaciones de costo y latencia, los discos duros siguen ofreciendo algo que el resto de la pila no puede reemplazar fácilmente: capacidad práctica a volumen masivo.

Y exactamente por eso la próxima parte de esta serie tendrá que examinar por qué los discos duros siguen siendo críticos para la infraestructura de IA.

Sobre el autor

Este artículo fue desarrollado bajo la dirección de Greg Morris, colaborador de larga trayectoria en GetUSB.info con más de dos décadas de experiencia en tecnología USB, comportamiento de la memoria flash y sistemas de almacenamiento de datos. La perspectiva presentada aquí refleja conocimiento práctico de la industria y un análisis continuo de cómo se comportan los sistemas reales bajo cargas de trabajo en evolución, incluida la infraestructura de IA.

Cómo se creó este artículo

Los conceptos, la estructura y la dirección técnica de este artículo fueron elaborados y revisados por un experto humano en la materia. Se utilizaron herramientas de IA para ayudar con el ritmo, la fluidez y la legibilidad, organizando ideas complejas en una narrativa más natural sin alterar la precisión técnica subyacente ni la intención original.

Sobre las imágenes

Las imágenes utilizadas en este artículo fueron creadas específicamente para ilustrar conceptos que son difíciles de capturar con fotografía de stock tradicional, como cuellos de botella en el flujo de datos, comportamiento de la jerarquía de memoria e ineficiencias a nivel de sistema. Las imágenes están diseñadas para reforzar las explicaciones técnicas y mejorar la claridad para los lectores.