Understanding USB Technology Beyond the Marketing

Ongoing analysis of flash memory, USB technology, and data security - explained clearly for those who want to understand what's actually happening.

Core Knowledge Areas

Flash Storage

How NAND works, endurance myths, performance behavior, and pricing trends.

USB Security

Copy protection, data leakage risks, write protection, and compliance realities.

Data Integrity

Testing tools, fake capacity drives, corruption issues, and verification methods.

USB Hardware

What's inside a flash drive, firmware behavior, and performance tradeoffs.

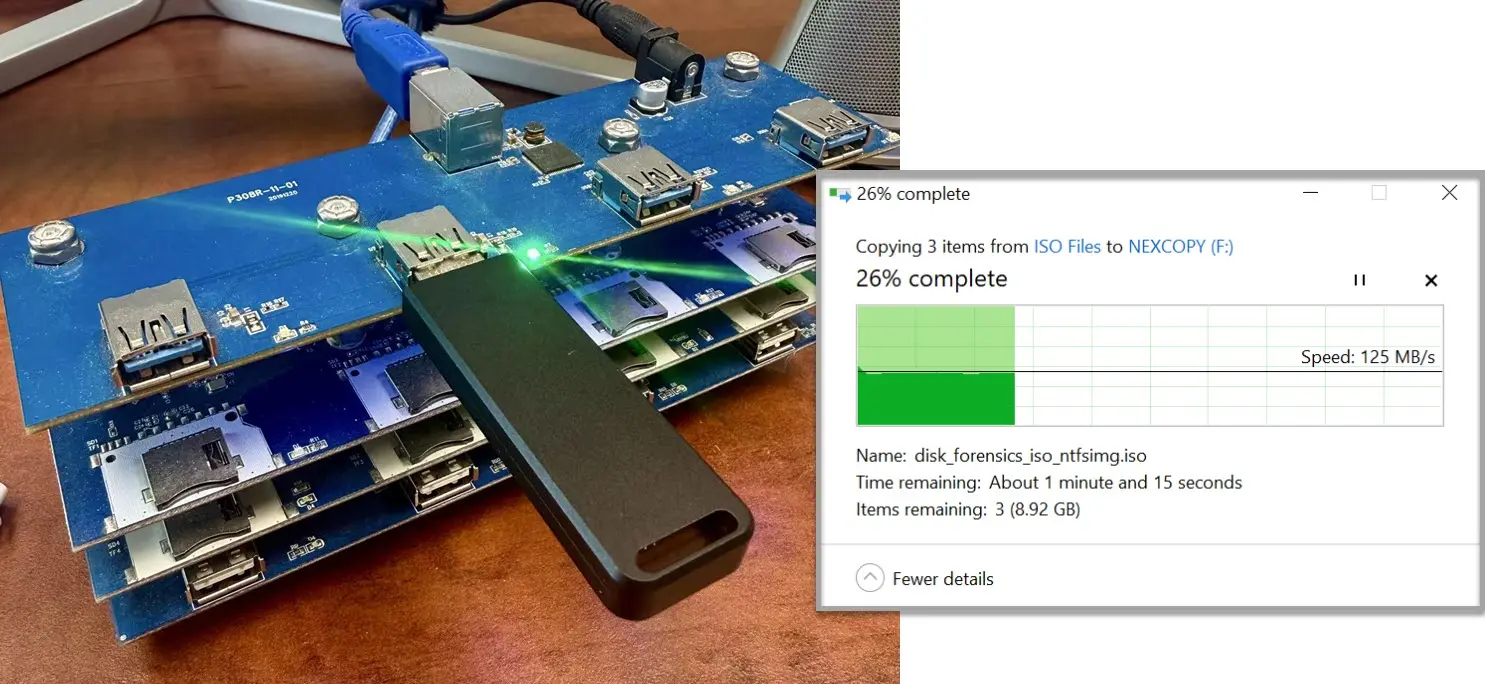

Duplication Systems

Mass production copying, verification methods, and workflow design.

Industry Analysis

Market shifts, supply constraints, AI demand, and flash pricing dynamics.

Featured Analysis

Deep dives into real-world USB behavior, flash memory economics, controller decisions, and security tradeoffs.

Latest Articles

Si USB-C es tan bueno, ¿por qué los televisores siguen usando HDMI?

Si no podemos mover agua por California, ¿cómo construiremos ciudades en Marte?

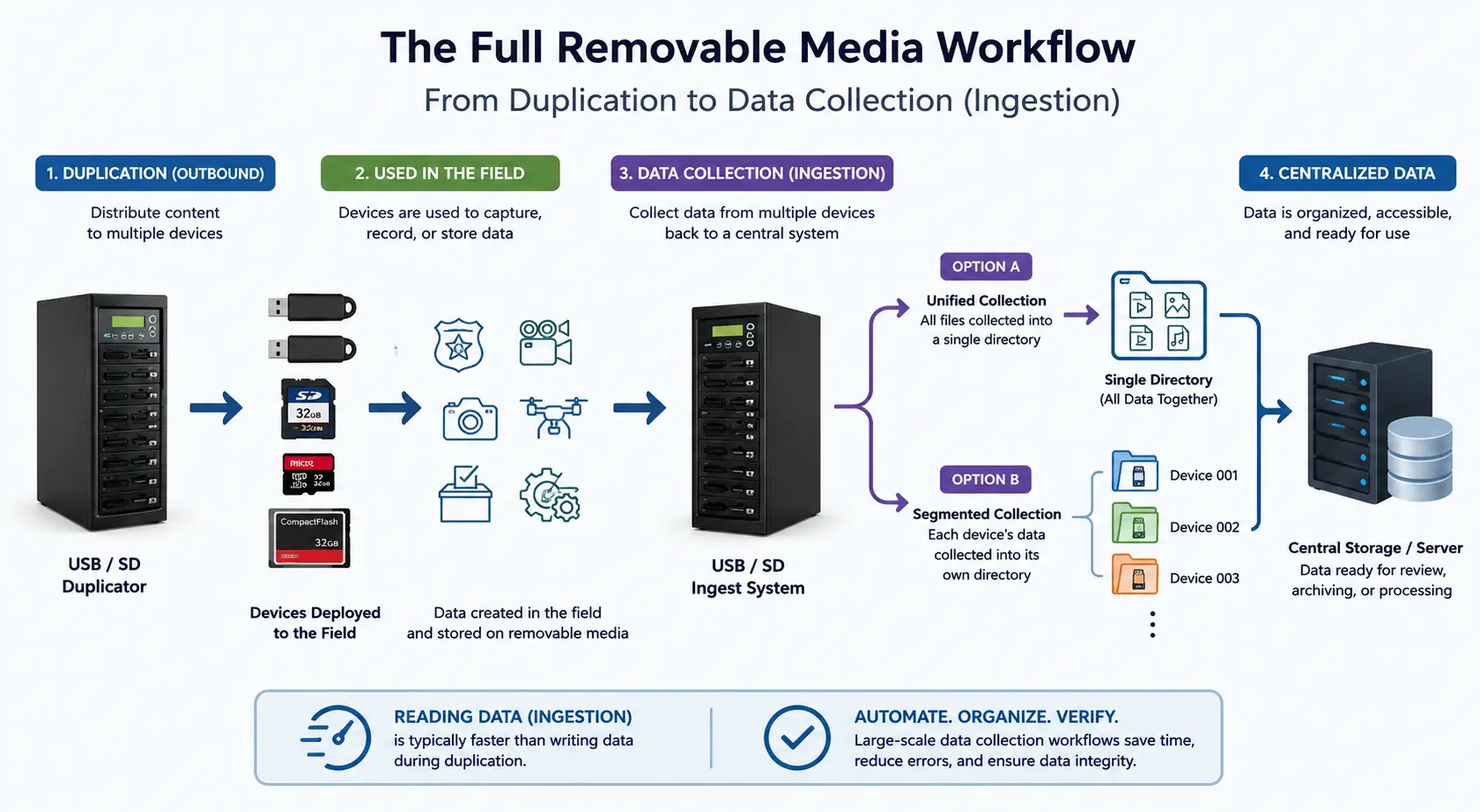

El lado que se pasa por alto de los medios extraíbles: workflows de recopilación de datos a gran escala

KV Cache: el depósito de memoria de IA que evita que las GPU se queden sin flujo

Mara Vale: El eco del air-gap | Cyberpunk noir sobre señales invisibles y fuga de datos