Qué es la High Bandwidth Memory (HBM) y por qué la IA depende de ella

Los sistemas de inteligencia artificial no suelen ralentizarse por limitaciones de cálculo, sino porque el sistema no puede mover los datos lo suficientemente rápido como para mantener al procesador constantemente alimentado de información.

En otras palabras, el cuello de botella no está en la capacidad de procesar datos, sino en la capacidad de entregar esos datos a la velocidad que requieren las cargas de trabajo modernas de IA.

Aquí es donde la High Bandwidth Memory (HBM) se convierte en una parte importante de la arquitectura.

Para una visión más amplia de cómo la memoria está evolucionando más allá del flash y por qué los sistemas de IA ahora dependen de múltiples niveles, consulta nuestro análisis principal: NAND no va a desaparecer, pero los servidores de IA ahora dependen de algo más que solo flash.

¿Qué es la High Bandwidth Memory (HBM)?

La High Bandwidth Memory es un tipo de DRAM apilada que se coloca extremadamente cerca del procesador, a menudo a solo unos milímetros del die de la GPU, con el objetivo de minimizar la distancia física que deben recorrer los datos.

A diferencia de la memoria de sistema tradicional, que depende de rutas eléctricas más largas y canales de datos más estrechos, HBM está diseñada en torno a la proximidad y el paralelismo, permitiendo mover significativamente más datos a la vez y con mucho menos retraso.

- Buses de memoria muy anchos, a menudo de miles de bits

- Distancias de conexión ultracortas entre memoria y procesador

- Acceso masivamente paralelo a los datos

El objetivo es claro: reducir la distancia entre donde se almacenan los datos y donde se procesan, porque en sistemas de alto rendimiento incluso pequeños retrasos se acumulan rápidamente.

En términos prácticos, la distancia se traduce directamente en latencia, y la latencia es uno de los principales factores que limitan el rendimiento de la inteligencia artificial.

Una forma sencilla de entender HBM

Una forma útil de visualizarlo es pensar en un sistema tradicional como una fábrica conectada a un almacén mediante una autopista.

Cada vez que la fábrica necesita piezas, estas deben transportarse de un lado a otro, lo que introduce retrasos, aumenta el consumo de energía y limita la velocidad a la que puede operar el sistema.

HBM cambia esa relación apilando, en la práctica, el almacén directamente encima de la planta de la fábrica.

En lugar de depender del transporte, todo está disponible de inmediato, eliminando los retrasos asociados al movimiento de datos a lo largo de mayores distancias.

Esto es, en esencia, lo que hace HBM para una GPU: coloca la memoria tan cerca del motor de cálculo que el movimiento de datos se vuelve casi instantáneo en comparación con los diseños tradicionales.

Cómo se construye físicamente HBM

La ventaja de HBM no está solo en el diseño, sino también en cómo se construye la memoria a nivel de silicio.

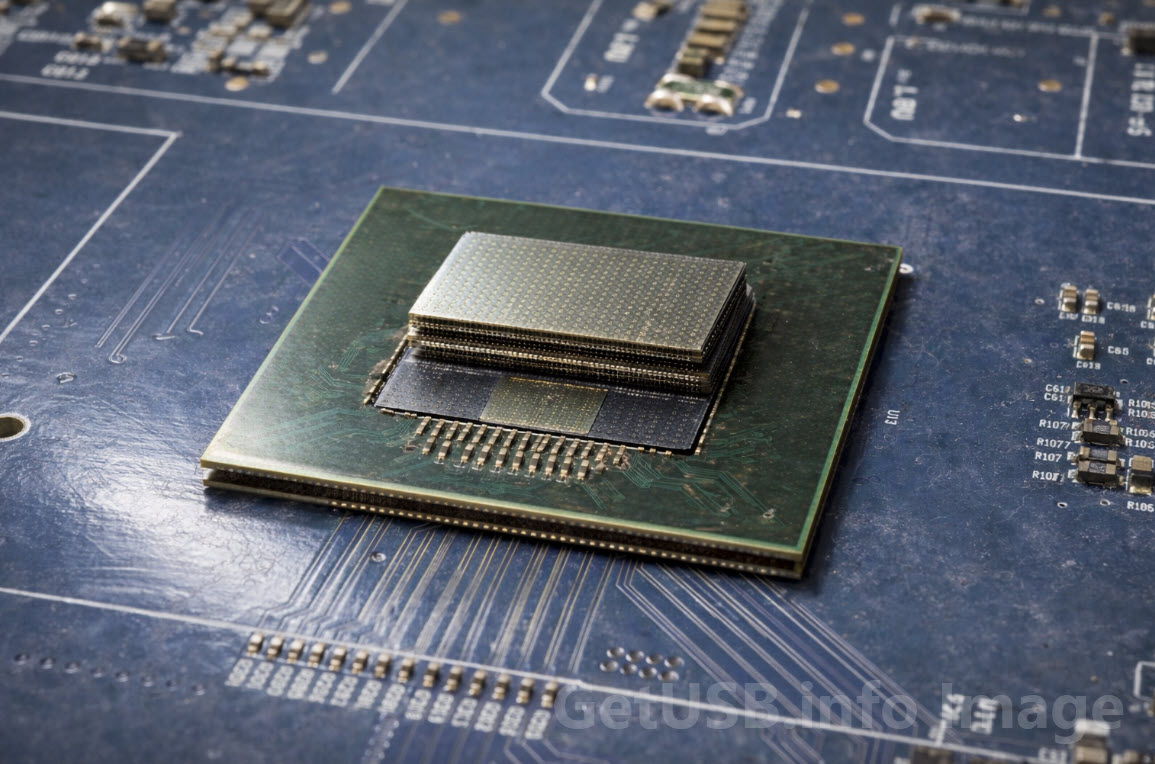

HBM se fabrica apilando múltiples dies de DRAM verticalmente y conectándolos mediante Through-Silicon Vias (TSV), que son diminutas vías verticales perforadas a través del silicio para permitir conexiones eléctricas directas entre capas.

Estos módulos de memoria apilados se montan después sobre un interposer junto a la GPU, formando un paquete altamente integrado donde memoria y cálculo funcionan como un sistema unificado en lugar de componentes separados.

El resultado es una combinación de caminos de datos extremadamente anchos y distancias eléctricas muy cortas, lo que en conjunto permite el alto ancho de banda que define a HBM.

Por qué la IA depende de HBM

Las cargas de trabajo de IA, especialmente durante el entrenamiento de modelos, requieren un movimiento continuo de grandes cantidades de datos, a menudo con miles de millones o incluso billones de parámetros que deben leerse, actualizarse y reescribirse repetidamente.

Esto genera una necesidad tanto de alto ancho de banda, para mover grandes conjuntos de datos rápidamente, como de baja latencia, para garantizar que los motores de cálculo no queden inactivos esperando datos.

- El alto ancho de banda garantiza que grandes volúmenes de datos puedan transferirse rápidamente

- La baja latencia asegura que las unidades de cálculo se mantengan plenamente utilizadas

Las arquitecturas de memoria tradicionales tienen dificultades para cumplir ambos requisitos al mismo tiempo, por lo que HBM se ha convertido en un componente estándar en los aceleradores de IA de gama alta.

Sin HBM, incluso la GPU más potente pasaría una parte significativa de su tiempo esperando datos en lugar de procesarlos.

El compromiso: velocidad frente a coste

Aunque HBM ofrece importantes ventajas de rendimiento, también introduce mayor complejidad y coste debido a su diseño apilado y a los requisitos avanzados de empaquetado.

El uso de múltiples capas de DRAM, interconexiones de precisión y la integración mediante interposer hacen que HBM sea una de las tecnologías de memoria más costosas disponibles actualmente.

Por este motivo, se reserva normalmente para aplicaciones donde el rendimiento es crítico y el coste puede justificarse, como el entrenamiento de IA y los entornos de computación de alto rendimiento.

Los sistemas de propósito general, donde la sensibilidad al coste es mayor, siguen dependiendo de soluciones de memoria más convencionales.

Dónde encaja HBM en el conjunto

HBM no sustituye a otros tipos de memoria, sino que se sitúa en la parte superior de una jerarquía de memoria en capas, donde cada nivel está optimizado para un equilibrio diferente entre velocidad, coste y capacidad.

| Tecnología | Latencia típica | Ancho de banda | Coste por GB | Rol principal |

|---|---|---|---|---|

| HBM (DRAM apilada) | Nanosegundos | Terabytes/s | Muy alto | Memoria para entrenamiento de IA |

| DDR DRAM | ~100ns | Alto | Alto | Memoria del sistema |

| NVMe SSD | Microsegundos–milisegundos | Moderado | Bajo | Almacenamiento masivo |

Cada nivel existe debido a los compromisos entre rendimiento, coste y capacidad, y ninguna tecnología puede optimizar los tres factores al mismo tiempo.

HBM ocupa el nivel de mayor rendimiento, donde la velocidad tiene prioridad sobre el coste, lo que la hace esencial para cargas de trabajo que no pueden tolerar retrasos.

El cambio

HBM no debe considerarse simplemente como memoria más rápida, sino como un cambio en el diseño de sistemas que acerca físicamente la memoria al procesamiento para eliminar uno de los mayores cuellos de botella de la computación moderna.

En los sistemas de IA, donde el rendimiento está directamente ligado a la rapidez con la que se puede acceder y procesar la información, este cambio arquitectónico desempeña un papel clave.

En última instancia, incluso los procesadores más avanzados dependen de un flujo constante de datos, y mejorar ese flujo es lo que hace que tecnologías como HBM sean tan importantes.

Nota editorial e imagen: Este artículo ha sido dirigido y revisado por GetUSB.info basándose en nuestra investigación editorial y en nuestro conocimiento técnico del empaquetado de memoria y el hardware de almacenamiento.

Nota sobre la imagen: La imagen utilizada en este artículo se basa en una fotografía real de un chip y ha sido mejorada para ilustrar mejor el concepto de HBM a los lectores. La mejora se ha realizado únicamente con fines explicativos, por lo que la imagen debe entenderse como una representación interpretativa realista y no como una fotografía literal de referencia de fabricación.

Cómo se creó este artículo: GetUSB.info proporcionó la dirección del contenido, el enfoque técnico y la revisión editorial final. Se utilizaron herramientas de IA para ayudar con el ritmo y la fluidez, con supervisión humana aplicada durante todo el proceso.

Tags: HBM, high bandwidth memory, infraestructura IA, memoria GPU, memoria IA